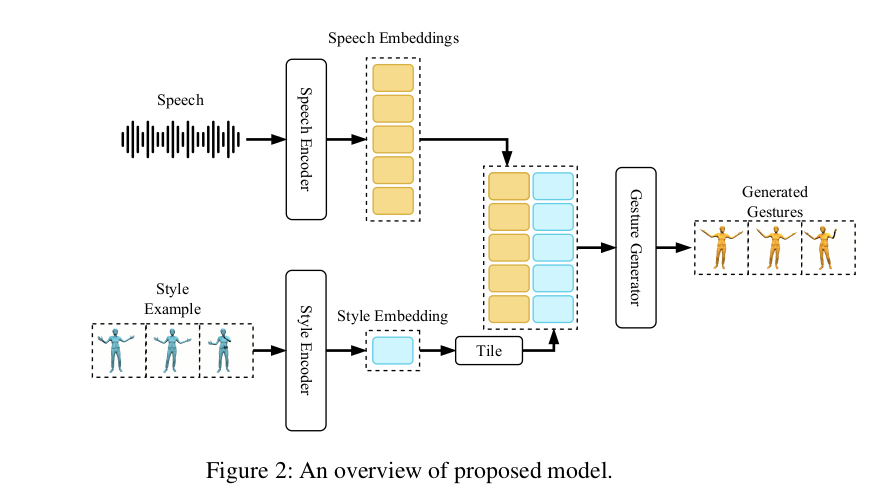

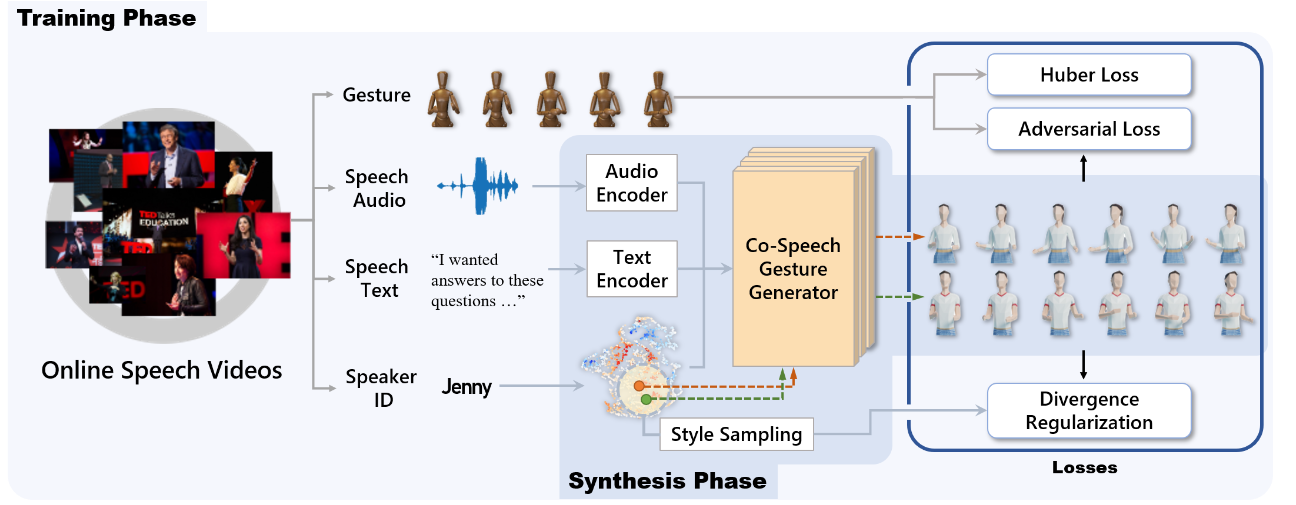

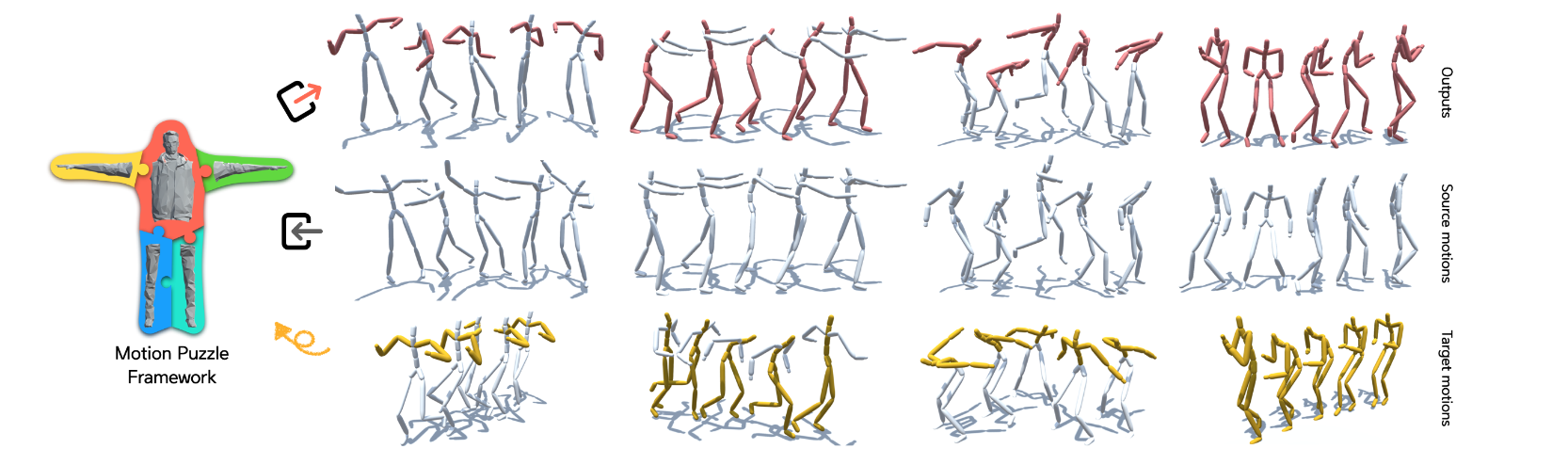

오늘두 역시나 gesture generation 관련 논문 리뷰! 작년 Siggraph Asia에서 직접 발표를 들었던 논문이라 더 반갑게 읽었던 것 같다. 그때도 생각했던거지만 다시봐도 결과물의 퀄리티가 꽤 괜찮다. 교수님 허락만 맡으면 논문세미나에서 발표할 생각이라 꽤 열심히 읽었지롱 https://arxiv.org/abs/2209.07556 ZeroEGGS: Zero-shot Example-based Gesture Generation from Speech We present ZeroEGGS, a neural network framework for speech-driven gesture generation with zero-shot style control by example. This means s..